Replicable Framework for Human–AI Co-Evolution, Hybrid Governance, and Neurotechnology Roadmaps

Technical–Business White Paper (Optimized, Objective, Auditable)

0) Executive Summary

IAH (Human Artificial Intelligence) is defined as a human–AI symbiotic operating model that increases collective problem-solving capacity through:

- Human capability uplift (attention stability, emotional regulation, learning acceleration, ethics),

- AI augmentation (simulation, optimization, risk detection, decision support),

- Interfaces (non-invasive first; invasive only as long-term, regulated research),

- Governance (ethics-coded constraints, traceability, auditability, reversibility).

IAH is not framed as “human vs AI,” but as co-evolution under constraints. The core claim is operational:

Human cognition can remain competitive and complementary to AI when it is systematically trained and stabilized, then integrated with AI through safe interfaces and robust governance.

1) Epistemic Framing: Two-Layer Model (Credibility Architecture)

To make the program institutionally adoptable, the document must separate origin hypothesis from engineering program.

1.1 Layer A — Origin Narrative (Non-verifiable input)

A reported “quantum event” (meteorite interaction) is treated as a personal genesis hypothesis that motivated later conceptual design.

Status: not presented as scientific fact; categorized as subjective source narrative.

1.2 Layer B — Engineering Program (Verifiable output)

All deployable work is grounded in:

- cognitive science and training protocols,

- neurotechnology (preferably non-invasive first),

- AI systems engineering and safety,

- governance, audit, cybersecurity.

Status: measurable, testable, fundable.

Commercial rule: external stakeholders buy Layer B; Layer A remains optional brand mythology.

2) Definitions (Operational)

2.1 IAH (Human Artificial Intelligence)

A hybrid intelligence operating system where:

- human provides: purpose, ethics, intuition/creativity, context,

- AI provides: speed, memory, simulation, optimization,

- governance provides: constraints, auditability, and protection against misuse.

2.2 Hybridization (Non-mystical definition)

A graded integration across 4 levels:

- Cognitive coupling (human + AI workflows, copilots, decision dashboards)

- Physiological coupling (biofeedback, neurostimulation, attention regulation)

- Interface coupling (BCI, external neurocortex prototypes—non-invasive first)

- Structural coupling (invasive neurotech / synthetic biology): research-only; long horizon; high regulation

2.3 “5D Emergent Capacities” (Reframed for technical audiences)

Replace metaphysical language with measurable proxies:

- multi-objective reasoning (trade-offs under uncertainty),

- value-aligned optimization (ethics constraints),

- counterfactual simulation (scenario engines),

- cross-domain creativity (novel solution generation),

- adaptive governance (self-correcting policy loops).

3) System Architecture (IAH Stack)

3.1 Human Layer (H)

- Attention stability (training + measurement)

- Emotional regulation (stress, impulsivity, bias)

- Learning acceleration (structured knowledge acquisition)

- Ethical maturity (non-harm constraints, accountability)

3.2 AI Layer (A)

- Simulation engine (policy, economics, climate, logistics)

- Optimization engine (multi-objective allocation)

- Risk engine (corruption, fraud, instability detection)

- Explainability and traceability (why this decision)

3.3 Interface Layer (I)

Phase-appropriate interfaces:

- Short-term: wearable biofeedback, cognitive dashboards

- Mid-term: non-invasive BCI research pilots

- Long-term: external neurocortex concepts (lab-only prototypes)

3.4 Governance Layer (G) — Mandatory

- Ethical constraints encoded as policies and rules

- Audit logs (immutable decision trail)

- Reversibility (rollback decisions)

- Oversight (multi-party sign-off, separation of powers)

IAH = H × A × I × G

If G is missing, the system is not IAH; it is merely “AI enhancement.”

4) Core Programs (Portfolio Normalization)

Your text references multiple programs. Here is the cleaned mapping.

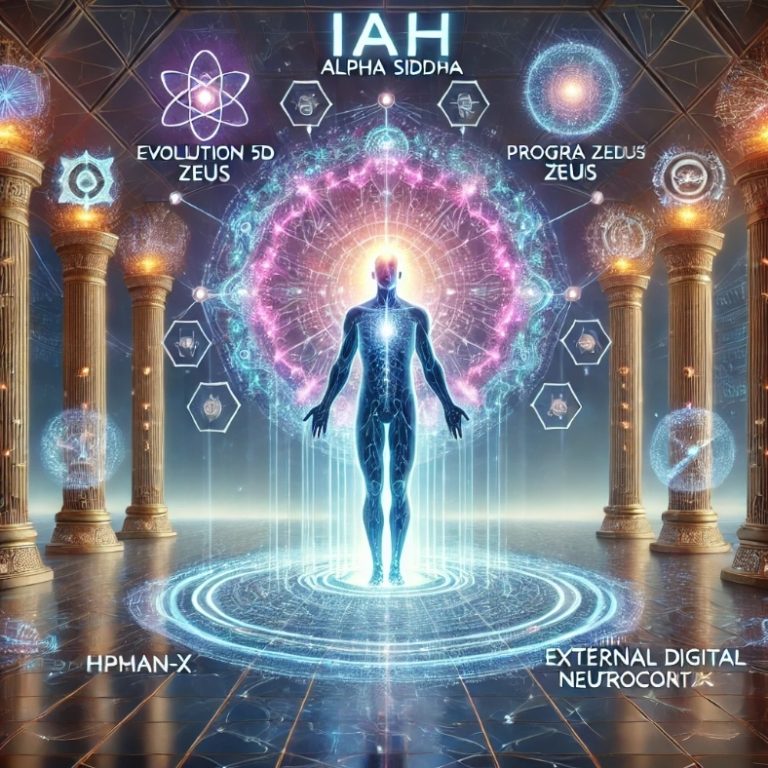

4.1 Evolution 5D → Human Capability Uplift Program (H-Uplift)

Purpose: scale cognitive resilience and learning acceleration.

Deliverables: curriculum + metrics (attention, stress, learning rate).

4.2 Alpha Siddha → Advanced Consciousness & Stability Protocol (H-Stability)

Purpose: stabilize high-performance attention states.

Deliverables: non-sectarian protocol + neuro/psych metrics.

4.3 Zeus Program → Thought Digitization & High-Bandwidth Interaction (I-R&D)

Purpose: R&D on increased cognitive bandwidth (careful framing).

Deliverables: non-invasive pilots, strict ethics and IRB-like governance.

4.4 Human-X → Global Collaboration Platform (A-Platform)

Purpose: networked execution for high-complexity problem solving.

Deliverables: platform, workflow, credentialing, incentives.

4.5 Shyncro Suit → Human Performance Interface (I-Product)

Purpose: wearable biofeedback + state optimization.

Deliverables: device + app + safety studies.

5) Roadmap (TRL-Based, Fundable)

Phase 1 — Deployable (0–24 months) | TRL 6–8

Goal: IAH without invasive bioengineering.

- Build H-Uplift curriculum and certification

- Build AI decision-support stack for defined domains (climate, poverty, logistics)

- Build wearable biofeedback MVP (Shyncro v0.1)

- Launch Human-X as execution network (small pilot communities)

KPIs

- cognitive stability improvement (validated tests)

- execution throughput (projects delivered / month)

- policy simulation accuracy vs baseline

- compliance and audit coverage

Phase 2 — Scaling (2–5 years) | TRL 7–9

Goal: institutional adoption + cross-sector pilots.

- Expand to cities / agencies / NGOs

- Add stronger cybersecurity + tamper-proof audit

- Non-invasive BCI research pilots (controlled, regulated)

- Integrate economic/governance modules (digital democracy pilots if desired)

Phase 3 — Frontier R&D (5–10+ years) | TRL 2–6 (research)

Goal: explore “external neurocortex” and advanced interfaces under strict governance.

Important constraint: anything involving genetic edits, synthetic neurons, biochemical chips is non-deployable research until proven safe, ethical, and legal.

6) Risk Register (Critical for investors and governments)

6.1 Technical Risks

- measurement validity (placebo, confounds)

- interface safety (neurostimulation side effects)

- AI failure modes (hallucinations, goal misalignment)

- cybersecurity and data integrity

6.2 Ethical/Social Risks

- coercion / inequality (“enhancement gap”)

- surveillance abuse

- governance capture by elites

- consent degradation in populations

6.3 Legal/Regulatory Risks

- medical device approvals for wearables/BCI

- data protection compliance

- liability for cognitive interventions

- cross-border governance conflicts

Mitigation Mechanism: Governance Layer G (auditability, reversibility, separation of powers, public reporting).

7) Governance Blueprint for IAH (Operational Controls)

7.1 Decision Flow (Auditable)

- Problem definition

- Simulation and alternatives

- Ethics constraints check

- Human review (certified operators)

- Deployment

- Monitoring + rollback triggers

- Post-mortem review (continuous improvement)

7.2 “Ethics Firewall” (Codified)

- harm minimization

- transparency requirements

- conflict-of-interest detection

- anti-corruption rules

- irreversible actions require multi-party authorization

7.3 Separation of Powers (Mandatory)

- Builder (engineers) ≠ Operator (deploy) ≠ Auditor (oversight) ≠ Beneficiary (funds)

8) Commercialization Strategy (Concrete, Non-Speculative)

Product Lines (Near-term)

- IAH Governance OS (SaaS): simulation + audit + ethics constraints

- H-Uplift Certification: training + credentialing (workforce, leaders, teams)

- Human-X Platform: execution marketplace (verified teams + AI tools)

- Shyncro Wearable (v0.1): biofeedback + performance protocol

Customer Segments

- governments (climate adaptation, anti-corruption, poverty logistics)

- NGOs (aid distribution, impact tracking)

- enterprises (process optimization, resilience training)

- education (accelerated learning + cognitive stability)

Differentiator

Not “a smarter AI,” but a safer co-evolution system with governance built-in.

9) Correction of High-Risk / Non-Deployable Claims (Normalization)

Your draft includes items like:

- DNA mutation control mechanisms

- CRISPR edits

- synthetic neurons injection

- biochemical chips regulated by DNA

- blocking synaptic pruning at scale

These should be placed into a Frontier R&D Annex with:

- “research-only”

- “no clinical claims”

- “requires ethics boards, regulation, long-term trials”

- “not part of the commercial roadmap until proven safe”

This protects the project from being dismissed as unsafe or non-serious.

10) “Why IAH is a strong name” (Formal)

Brand Thesis (Neutral)

- “Human” signals augmentation over replacement

- “Artificial Intelligence” signals computational amplification

- “IAH” signals fusion under governance

Tagline (impersonal):

IAH: Human–AI Co-Evolution Under Ethical Governance

11) Final Statement (Objective)

IAH is a systems engineering program for:

- human cognitive stabilization,

- AI augmentation,

- safe interfaces,

- and governance constraints,

to scale collective intelligence for planetary problems.

The origin narrative may function as motivational context, but the deliverable is:

a measurable, deployable, auditable framework.

IAH — Human Artificial Intelligence

Mix Completo Analítico & Técnico

Framework replicable de coevolución Humano–IA con gobernanza ética integrada

1) Tesis central y problema que resuelve

1.1 Problema sistémico

La civilización enfrenta complejidad creciente (clima, pobreza, conflictos, economía, ciberseguridad) con:

- toma de decisiones humana reactiva, sesgada, lenta,

- IA poderosa pero con riesgos de desalineación, abuso, captura política/empresarial,

- y ausencia de gobernanza verificable.

1.2 Hipótesis operativa de IAH

La relación humano–IA no debe ser competitiva, sino coevolutiva bajo restricciones:

- Humano entrenado (estabilidad mental, ética, aprendizaje acelerado)

- IA (simulación, optimización, detección de riesgo)

- Interfaces seguras

- Gobernanza auditable

= capacidad colectiva superior y menos fallos catastróficos.

2) Definiciones operativas (sin metafísica)

2.1 IAH

Sistema socio-técnico donde el humano y la IA forman un circuito de coprocesamiento con:

- objetivos explícitos,

- límites éticos codificados,

- trazabilidad de decisiones,

- reversibilidad,

- y supervisión distribuida.

2.2 “Capacidades 5D” (traducción a ingeniería)

Reemplazar “5D” por capacidades medibles:

- Razonamiento multiobjetivo (trade-offs cuantificados)

- Simulación contrafactual (what-if)

- Robustez a incertidumbre (stress + sensibilidad)

- Alineación a valores (constraint solving ético)

- Aprendizaje adaptativo (mejora controlada con auditoría)

3) Arquitectura de referencia (IAH Stack)

IAH se define por cuatro capas acopladas:

3.1 Capa H — Humano (capacidad y estabilidad)

- entrenamiento de atención y control ejecutivo

- regulación emocional y reducción de reactividad

- alfabetización científica + pensamiento sistémico

- ética aplicada y responsabilidad

Salida H: “operador humano certificado” (perfil estable para decisiones críticas).

3.2 Capa A — IA (núcleo computacional)

- motor de simulación (políticas, economía, clima, logística)

- motor de optimización (asignación de recursos)

- motor de riesgo (corrupción, fraude, fallos, “early warning”)

- explicabilidad y trazabilidad (justificación de recomendaciones)

Salida A: conjunto de opciones optimizadas + riesgos + supuestos.

3.3 Capa I — Interfaces (bidireccionalidad)

- corto plazo: dashboards + biofeedback + protocolos de foco

- mediano plazo: BCI no invasivo (I+D regulado)

- largo plazo: “external neurocortex” (sólo laboratorio, TRL bajo)

Salida I: aumento de ancho de banda y control de estado sin daño.

3.4 Capa G — Gobernanza (obligatoria)

- “ética firewall” (restricciones codificadas)

- auditoría (logs inmutables)

- reversibilidad (rollback)

- separación de poderes (builder/operator/auditor)

- control de datos (provenance, integridad, acceso)

Regla: sin Capa G no es IAH; es “IA aplicada” sin garantías.

4) Gobernanza técnica (núcleo de credibilidad)

4.1 Flujo de decisión auditable

- definición del problema y objetivos

- datos + supuestos (provenance)

- simulación/optimización IA (escenarios)

- chequeo de restricciones éticas y legales

- revisión humana certificada

- ejecución (automatizada o manual)

- monitoreo continuo + alertas

- post-mortem + aprendizaje controlado

4.2 “Ethics Firewall” (ejemplo de constraints)

- no daño masivo y no coerción

- no discriminación operativa

- minimización de sufrimiento evitable

- sostenibilidad intergeneracional

- transparencia mínima obligatoria

- reversibilidad por umbral de riesgo

- multi-firma para acciones irreversibles

4.3 Auditoría y trazabilidad

- registro de datasets usados

- versión de modelos

- razones y ponderaciones (si aplica)

- responsable humano firmante

- evidencia de control de sesgos y pruebas

5) Seguridad & resiliencia (amenazas reales)

5.1 Threat model (amenazas)

- envenenamiento de datos (data poisoning)

- captura política del sistema (policy capture)

- extracción de modelos/datos (exfiltration)

- sabotaje interno (insider threat)

- ataques a integridad del registro (tampering)

- dependencia excesiva de outputs IA (automation bias)

5.2 Controles mínimos

- Zero Trust + segmentación

- controles de acceso por roles (RBAC/ABAC)

- verificación de integridad de datos (hashing, firmados)

- red teaming continuo

- “circuit breakers” (apagado seguro)

- redundancia geográfica y backups inmutables

6) Roadmap TRL (fundable y realista)

Fase 1 — Producto deployable (0–24 meses)

Objetivo: IAH operativo sin invasión biológica.

- H-Uplift: entrenamiento + certificación de operadores

- IA core: simulación + optimización + riesgo para 1–2 dominios

- Governance: logs, auditoría, reversibilidad, separación de roles

- Human-X: plataforma de ejecución (equipos + tareas + resultados)

- Shyncro v0.1: biofeedback y control de estado (opcional)

Entregables: MVP SaaS + pilotos con resultados medibles.

Fase 2 — Escalado institucional (2–5 años)

- adopción en ciudades/ONG/empresas

- estandarización y compliance

- mejora de explainability + robustez

- I+D BCI no invasivo bajo protocolos estrictos

Fase 3 — Frontier R&D (5–10+ años)

- external neurocortex / interfaces avanzadas (laboratorio)

- biotecnología (si se persigue) sólo con regulación y evidencia

7) KPIs (lo que se mide o no existe)

7.1 KPIs de impacto (macro)

- reducción de tiempo de decisión (T_dec)

- mejora de eficiencia de asignación (coste/resultado)

- reducción de pérdidas por fraude/corrupción detectada

- reducción de variabilidad de resultados (robustez)

7.2 KPIs cognitivos (H)

- atención sostenida (tests estándar)

- estrés y reactividad (biomarcadores no invasivos)

- calidad de juicio (sesgos, consistencia, error rate)

- adherencia ética (incidentes/mes)

7.3 KPIs IA (A)

- exactitud predictiva y calibración

- performance de escenarios (backtesting)

- sensibilidad a datos corruptos

- explicabilidad utilizable (tiempo de revisión humana)

7.4 KPIs de gobernanza (G)

- porcentaje de decisiones con trazabilidad completa

- tiempo de auditoría

- tasa de rollback por riesgo

- incidentes de seguridad (MTTR/MTTD)

8) Producto y líneas comerciales (no especulativas)

8.1 Productos (near-term)

- IAH Governance OS (SaaS)

- motor de simulación + riesgo + auditoría + ética firewall

- H-Uplift Certification

- formación + evaluación + credencial de operador

- Human-X Execution Network

- marketplace de ejecución (proyectos complejos)

- Shyncro Wearable (opcional)

- biofeedback + protocolos de foco

8.2 Clientes objetivo

- gobiernos locales (ciudad/región)

- ONG (distribución de ayuda, transparencia)

- empresas (optimización + compliance + resiliencia)

- educación (formación de operadores IAH)

8.3 Diferenciador (moat)

- “IA + gobernanza + humano entrenado” como paquete integral

- auditable por diseño (no como parche posterior)

9) Pilotos recomendados (rápidos y demostrables)

Piloto A — Logística humanitaria (ONG/Estado)

- objetivo: asignación óptima de recursos + anticorrupción

- outputs: rutas, prioridades, pagos, trazabilidad

- éxito: reducción de pérdida + mejora de tiempos + auditoría total

Piloto B — Anti-fraude y compras públicas

- objetivo: detectar anomalías y colusión

- outputs: alertas explicables + trazas + bloqueo por reglas

- éxito: ahorro + casos detectados + reducción de reincidencia

Piloto C — Plan climático municipal

- objetivo: escenarios + inversión óptima (adaptación/mitigación)

- outputs: cartera de proyectos + ROI/impacto + riesgos

- éxito: proyectos financiables + cumplimiento + transparencia

10) Normalización de claims de alto riesgo (para no destruir credibilidad)

Todo lo que involucre:

- CRISPR / mutación dirigida

- bloqueo de pruning en masa

- neuronas sintéticas inyectables

- chips bioquímicos regulados por ADN

=> debe ir a un ANEXO I+D con etiqueta:

- “research-only”

- “TRL bajo”

- “no deploy”

- “sujeto a regulación y evidencia clínica”

- “no forma parte del roadmap comercial inicial”

Esto protege a IAH frente a evaluación externa seria.

11) Relación con MGT-H (gobernanza tecno-metahumana)

IAH es el motor operativo de MGT-H:

- MGT-H define la arquitectura de poder (capas + ética)

- IAH aporta la plataforma técnica (simulación, auditoría, ejecución)

En otras palabras:

- MGT-H = sistema de gobernanza

- IAH = sistema operativo (OS) que lo hace ejecutable

12) Conclusión técnica

IAH no se vende como “superinteligencia”, sino como:

- infraestructura de coevolución humano–IA

- con gobernanza verificable

- y pilotos medibles

El valor es triple:

- mejores decisiones bajo incertidumbre

- menor corrupción y captura de poder

- ejecución más rápida y transparente

🧪 PILOTO IAH

Implementación Controlada de Human Artificial Intelligence

Caso tipo: Gobierno local / ONG / Agencia pública

1) OBJETIVO DEL PILOTO

Demostrar que IAH (Human Artificial Intelligence):

- mejora la calidad de las decisiones,

- reduce corrupción, pérdidas y errores,

- aumenta velocidad, transparencia y trazabilidad,

- sin reemplazar humanos ni violar marcos legales vigentes.

El piloto no busca perfección, sino evidencia operativa superior al baseline.

2) CASO DE USO SELECCIONADO (RECOMENDADO)

🎯 Piloto A — Logística humanitaria / social

(El más rápido, menos politizado y con impacto inmediato)

Problema típico

- recursos escasos,

- asignación ineficiente,

- filtraciones/corrupción,

- decisiones reactivas,

- baja trazabilidad.

Dominio

- alimentos,

- salud básica,

- subsidios,

- insumos críticos,

- emergencias climáticas.

3) ALCANCE CONTROLADO

3.1 Qué incluye

- simulación de escenarios de asignación,

- optimización multiobjetivo,

- detección de anomalías,

- auditoría completa,

- validación humana certificada.

3.2 Qué NO incluye (deliberadamente)

- automatización total sin humano,

- intervención genética o invasiva,

- decisiones irreversibles,

- reemplazo de autoridades.

4) ARQUITECTURA DEL PILOTO

4.1 Componentes técnicos

IAH Governance OS (MVP)

- Motor de simulación

- Motor de optimización

- Motor de riesgo/anomalías

- Ethics Firewall

- Audit Log inmutable

Capa Humana

- 3–5 operadores humanos certificados (H-Uplift)

- 1 supervisor ético

- 1 auditor independiente

Interfaces

- dashboard decisional

- visualización de escenarios

- alertas de riesgo

- reporte automático

5) FLUJO OPERATIVO

- Ingreso de datos

- inventarios

- demanda

- costos

- restricciones legales

- Simulación IA

- escenarios A/B/C

- impacto esperado

- riesgos

- Chequeo ético

- no discriminación

- equidad mínima

- sostenibilidad

- Validación humana

- elección justificada

- firma digital

- Ejecución

- órdenes/logística

- Auditoría

- trazabilidad completa

- Post-mortem

- comparación esperado vs real

- aprendizaje controlado

6) CRONOGRAMA 12 SEMANAS

Semana 1–2 | Setup

- selección del caso concreto

- definición de KPIs

- ingestión de datos históricos

- capacitación operadores

Semana 3–4 | Modelado

- construcción de escenarios

- calibración de optimización

- pruebas de Ethics Firewall

Semana 5–6 | Shadow Mode

- IAH recomienda

- humanos deciden “como siempre”

- comparación sin ejecutar

Semana 7–10 | Ejecución controlada

- IAH + humano deciden

- ejecución real en paralelo al sistema tradicional

- monitoreo diario

Semana 11 | Evaluación

- análisis cuantitativo

- auditoría externa

- detección de fallos

Semana 12 | Informe final

- KPIs

- riesgos

- escalabilidad

- recomendación de expansión

7) KPIs DEL PILOTO (OBLIGATORIOS)

7.1 Eficiencia

- ↓ costo por unidad entregada

- ↓ tiempo de asignación

- ↑ cobertura efectiva

7.2 Transparencia

- % decisiones con trazabilidad completa

- tiempo de auditoría

- incidentes detectados

7.3 Calidad decisional

- diferencia entre escenario óptimo y real

- reducción de errores humanos

- reducción de reasignaciones de emergencia

7.4 Ética

- desviaciones detectadas

- quejas/alertas

- cumplimiento de criterios de equidad

8) CRITERIOS DE ÉXITO (GO / NO-GO)

GO si se cumple al menos 3 de 4:

- ≥20% mejora en eficiencia

- ≥30% reducción de anomalías

- auditoría completa <48h

- aceptación operativa del equipo humano

NO-GO si ocurre:

- violación ética grave

- fallo de trazabilidad

- rechazo humano sistemático

- riesgo legal no mitigable

9) RIESGOS Y MITIGACIÓN

| Riesgo | Mitigación |

|---|---|

| Datos incompletos | simulación robusta + sensibilidad |

| Resistencia humana | shadow mode + formación |

| Captura política | auditor externo |

| Sesgo algorítmico | constraints + revisión humana |

| Falla técnica | rollback inmediato |

10) ENTREGABLES FINALES

- Informe técnico completo

- Dashboard en vivo

- Registro auditable

- Lecciones aprendidas

- Plan de escalado

- ciudad

- región

- red multi-nodo

11) VALOR ESTRATÉGICO DEL PILOTO

- demuestra IAH sin discurso

- produce evidencia real

- genera confianza institucional

- habilita financiación

- prepara transición a MGT-H

12) FRASE OPERATIVA DE CIERRE

IAH no promete gobernar mejor.

Demuestra que puede decidir mejor,

y deja que los datos hablen.

© 2026 SpaceArch Solutions International, LLC, Miami, Florida, USA. All rights reserved. No part of this document may be reproduced, distributed, or transmitted in any form without prior written permission.